[學AI] AI 為何讓職場更忙?從幻覺、落地摩擦到可控工作流

很多職場人士都遇過這樣的場景。午飯後回到辦公室座位,公司電郵和內部通訊工具彈出幾條訊息:「客戶想要另一個方向」、「今晚八點前要出 revised deck」、「順便幫忙寫一封回覆,語氣要友善」。

此時,我們自然地打開 AI,輸入一句「幫我寫個 proposal」。畫面立刻出現一大段文字。看起來完整,有條理,還帶點顧問的味道。但手停在鍵盤上,心裡反而更慌。這段文字能直接交出去嗎?口吻像我們公司嗎?合規會不會出問題?數字靠不靠譜?最重要的是,這封信用公司名義發出去,最後負責的是誰?

於是,辦公室裡熟悉的循環又開始了。第一輪改到「差不多」,第二輪 AI 改得「走了樣」,第三輪同事說「不切實際」。最後主管走過來問:「重點是什麼?資料核對清楚沒有?」

這不是個別情況。最近 METR 做了一項研究。他們找來資深開源軟件開發者,用 2025 年的 AI 工具(比如 Cursor 加 Claude 3.5/3.7 Sonnet)完成真實開發任務,結果卻出人意料。平均花的時間多了 19%,但受試者開工前預期會快 24%,做完後還覺得自己快了 20%。該研究指出,這不代表 AI 讓所有人變慢,而是反映出現實中的問題。AI 輸出需要審核,人在壓力下容易過度依賴工具,資深人員也容易遇到效率提升越來越少的情況。

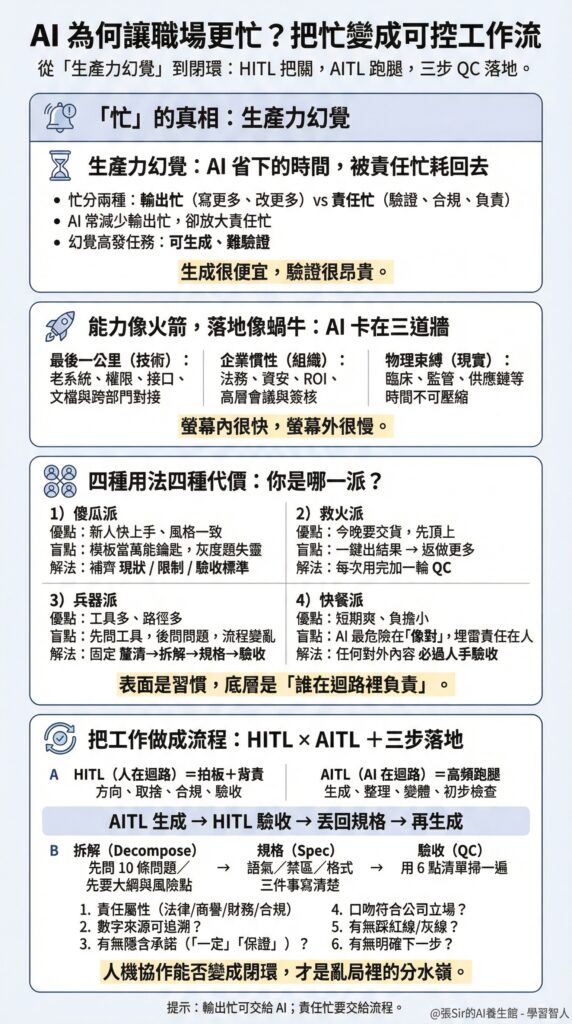

最讓人難受的不是「變慢」,而是「覺得變快了」。這種感覺就是所謂的「生產力幻覺」。

日常工作中的忙有兩種。一種是輸出忙(寫得多、改得多),另一種是責任忙(驗證、合規、負責)。AI 確實能減少輸出忙,但常常讓責任忙更嚴重。所以幻覺最容易出現在「可以生成,但難以驗證」。

以上情景的出現,背後其實有三件事正在同時發生,包括技術普及的速度跟不上實際應用,未來經濟潛在風險增加,以及我們的工作方式也在徹底改變。

能力像火箭,落地像蝸牛:AI 卡在三道牆

大家最近可能都有個疑問:既然 AI 已經厲害到可以自動寫APP、可以通過律師考試、可以自動生成電影級的影片,為什麼我們的 ERP 系統還是那麼難用?為什麼申請個流程還是要填表?

近日成為焦點的 Anthropic CEO Dario Amodei,曾用一個很有穿透力的框架解釋這種現象:我們正站在兩條曲線的撕裂點。

一條是能力曲線(Capability Curve)在上升,AI 能力像火箭升空,呈指數式增長;另一條是擴散曲線(Diffusion Curve)在慢行,技術真正落地到組織、流程與制度的速度,像蝸牛在爬。

想像一下,如果今天有人發明了「傳送門」,一站上去就能到達倫敦。理論上交通運輸業會被顛覆,但現實中,我們不可能明天就廢除機場和交通工具。政府要立法、城市要重新規劃、大眾要克服恐懼。傳送門再厲害,也頂不住「現實的審批流程」。

這就是我們現時的處境。AI 能力已經很強,但它撞上了現實世界的三道牆。

第一道牆是技術的最後一公里。AI 可以一秒寫出漂亮程式碼,但公司內部可能還是使用著二十年前的老系統。IP 設定錯誤、權限卡在人事部、資料庫命名混亂、接口沒有文檔……這些瑣碎細節,AI 不會自動替你走跨部門流程,最後仍要人一個一個去對接。

第二道牆是企業的慣性。新創公司可能五分鐘就部署好 AI,但大型機構要引入軟件工具,要過法務、過資安、算 ROI、開高層會議。AI 不能代簽、不能代責,會議也不會因為大語言模型更強而自動少一輪。官僚體制與技術革新的時差,很多時候就卡在這裡。

第三道牆是物理世界的束縛。就算 AI 一天能設計出抗癌藥,後面的動物實驗、人體臨床、監管審批仍要三到十年。生物反應的時間縮短不了,物理世界也不會像軟件一樣版本升級就加速。

所以,我們會覺得現實有些割裂。螢幕裡的 AI 像 2026 年的數碼天才,螢幕外的流程卻停在 2010 年。更諷刺的是,人類總以為自己在管理工具,直到某天發現真正管理我們的,是流程、權限與合規。

把 2028 當終點的壓力測試:AI 太成功會怎樣?

前面講完「慢」,要再講一段「快」。

今天我們覺得忙,很多時候來自制度還未吸收技術;一旦制度追上,忙的形態可能會變,甚至從忙轉向資源及工作的再分配。

近日,研究機構 Citrini Research 發布一份名為《The 2028 Global Intelligence Crisis》的報告,他們做了一個極端但很有啟發性的思想實驗。它用倒敘敘事把 2028 年當成終點,回推危機如何一路形成。核心問題是:假如 AI 太成功,產業結構會如何失衡?

報告提出了幾個關鍵的推演。

其一是「幽靈 GDP」(Ghost GDP)。它講的是 AI 把內容、程式碼、服務的產出拉到很高,宏觀數據很漂亮,但機器不會消費。這好比廚房出菜快如閃電,餐廳裡卻沒有客人吃。在這種有產出、無消費的情況下,經濟數據與普通人的體感就開始脫鉤。

其二是「摩擦歸零」(Friction Went to Zero)。它講的是未來 AI Agents(智能代理)幫人格價、訂機票、選保險。人會為品牌情感買單,而代理只看效率與數據。這樣,靠資訊不對稱與中介費生存的產業,可能被擠壓到利潤趨近於零。

其三是一條更嚴酷的價值鏈。白領被取代、消費萎縮、信貸收縮與連鎖反應,並假設 2028 年可能出現失業率超 10%、S&P 下跌近 40% 這一類的危機情景。這些數字當然是一種劇本式推演,重點不在它準不準,而在它逼我們看清現實,就是 AI 造成的衝擊,可能先落在白領,而不一定先落在藍領;加上政策與制度的滯後,會把這種衝擊放大。

這個報告出來之後,引發大量的討論,也帶來不少爭議,說它是一種敘事、製造恐慌。不過,有一點值得警惕的是,它提醒了我們,未來的競爭,不只在「誰做得更好」,還在「誰仍被需要」。很多人談 AI 只談模型有多強,卻避談價值鏈,像只看廚房火力有多猛,廚師的廚藝有多好,卻不看餐廳還有沒有客人。

AI四種用法四種代價:你是哪一派?

回到辦公室現場,其實我們已經分化出幾種很典型的 AI 使用流派。先把這些流派講清楚,後面再談怎樣把它們收束成一條可控的工作流。

第一,「傻瓜派」喜歡收集提示詞(Prompts)。其好處是新人上手快,交付風格一致;缺點是把模板當萬能鑰匙,遇到合規、政治敏感的灰度題,模板救不了判斷。比較穩的做法,是把模板當開場,中段補三樣東西:現狀、限制、驗收標準,讓 AI 有扶手可順著走。

第二,「救火派」講究速度,AI 出初稿就先頂上去。其好處是今晚要交貨,能救急就是好工具;缺點是永遠停留在「一鍵出結果」,後面用更多時間修改、補漏洞、向他人道歉。AI 像開得太大的水龍頭,火是熄了,辦公室也水浸了,最後大家忙著幫手拖地。更穩的做法,是救火可以,但每次用完補一點 QC,慢慢把救急變成常規。

第三,「兵器派」今天學這個工具,明天試那個模型。其好處是兵器庫夠嚇人,遇到突發事不容易卡死;缺點是先問用哪個工具,而不是先問要解決什麼問題。工具越多,流程越亂。比較務實的做法,是固定一套「釐清→拆解→規格→驗收」的流程,工具變成只是換個執行者。

第四,「快餐派」覺得 AI 寫得順眼就直接發出去。這樣做短時間內填飽肚子,感覺舒服。缺點是 AI 最危險的地方是既有內容,且看起來還像真的。一旦出錯,比如資料錯誤、承諾太多、語氣不對、違反規則,責任都由人來承擔。唯一能救這類做法的,就是一條鐵律:所有對外發出的內容,都必須有人檢查。

從以上的四個流派可以看出,表面上是不同的習慣,底層其實是「誰在迴路裡負責」:哪些步驟交給 AI 去完成,哪些步驟需要人把關。這就回到我一直以來提倡的兩個關鍵概念:HITL與 AITL。

把工作做成產線:HITL 把關,AITL 跑腿

這場AI變革更像一次辦公室內部的工業革命。我們把原本依賴個人手藝、經驗、直覺的知識工作,拆成可標準化的生產線。哪一段生成、哪一段驗證、哪一段交付,邊界越清楚,修改就越少,責任也越可控。

HITL(Human-in-the-loop,人在迴路)是把關角色,像項目總監審核報告,審的不是格式細節,而是論點站不站得住腳、策略符不符合公司利益、有沒有踩合規紅線、有沒有把「可能」寫成「必然」。但方向與驗收由人拍板時,責任最後便落在真人身上,AI 則不會為人作賠償。

AITL(AI-in-the-loop,AI 在迴路)是跑腿角色。標準化、重複性高、耗時間的工作,例如整理會議記錄、做十個文案版本、找代碼錯誤、把散亂資訊變成清單等等,讓 AI 在迴路裡按指令縱橫就行。

因此,理想的工作流像一場接力賽。AI 生成與整理(AITL),人決策與驗收(HITL),再把規格與約束指令丟回 AI。很多人越用越忙,往往是因為把生成誤當完成,然後把最昂貴的責任成本留到最後一刻才補上去。

三步把 AI 關進流程:拆解、規格、QC 清單

不想被「生產力幻覺」困住,可以把工作變成三步。它看上去像增加流程,實際上是在降低重複修改的深淵,把耗時的責任提前處理掉。

首先是拆解(Decompose)。與其叫 AI「幫我寫個方案」,不如先叫它「幫我釐清下一步」。例如「先問我 10 條問題,了解目標和限制」、「幫我列出 5 個風險點」、「給出 3 個不同語氣的草稿選項」。把大任務拆碎,AI 就不容易亂填空,人也更早看見真正的風險。

其次是規格(Spec)。AI 不會讀心術,但它善於守規矩。我們可以把隨意寫成規格,例如語氣要專業但不油膩,少形容詞,多結論與依據;禁區要清楚,例如不要承諾業績、不要引用競品名字、不要寫超出授權的條款;格式也要定,例如先摘要,再列選項,最後給建議與下一步。規格越清楚,後面的 QC 成本就越低。

最後是驗收(QC)。把驗收變成標準動作,例如叫 AI「先出大綱再寫全文」、「標註所有你不確定的數據」、「列出這份方案可能的漏洞」。然後人用一個固定清單快速掃一遍:

- 這份內容承擔什麼責任(法律/商譽/財務/合規)?

- 文中的數字與事實,來源是否可追溯?

- 有沒有隱含承諾(例如「保證」「一定」「必然」)?

- 口吻是否符合公司立場與文化?

- 有沒有踩到內部政策或外部監管的紅線?

- 有沒有一句明確的下一步能推動的事情?

這就是 HITL 的核心。我們不一定要親手寫每個字,但要負責判斷它值不值得發出去。

最後的勝負:閉環系統,而非爆款工具

我們正站在一個很奇妙的時間點。

一方面,Amodei 曾預測 AGI(通用人工智能)可能在 2026 或 2027 年出現,並警告這可能帶來就業大幅縮減、需要加速 AI 安全研究。這種預測充滿爭議,也不必當成時間表,這更像情景推演。然而,它也像警報器,提醒我們變化不一定會很慢。

另一方面,Citrini 用極端劇本提醒我們,當 AI 的能力開始侵蝕白領的價值鏈,衝擊可能先體現在消費與信貸,而不只是「多了幾個更好用的助手」。

對職場人士來說,焦慮很昂貴,因為它消耗判斷力。更化算的,是把注意力放回如何更好地落地,是否能回答:誰能把神級的能力嵌入平庸的現實?誰能打通老舊系統?誰能搞定跨部門流程?誰能把 AI 的產出變成安全、可交付、可追責的商業價值?

對企業來說,未來的競爭也不只在模型參數上,更在誰能把「交付成果」變成一門工程學:把任務拆解、把規格寫清、把驗收標準化。很多公司以為自己在買「降本增效」的工具,實際上買的是一面鏡子。它能照出自己流程有多亂、權責有多模糊、合規有多靠運氣。輸出的量雖然變便宜了,但付出去的成本反而變高了。如果沒看見這個現實,就很容易把忙碌當成努力,把善後當成敬業。

到最後,真正能站穩的團隊,靠的是一套閉環,而非某一個爆款工具。人類負責決策把關與驗收,AI 負責高效執行與整理,兩者來回迭代,讓效率、風險與責任都可控。閉環建立起來,我們才算駕馭這股力量,否則很容易被它的產出量淹沒。這也是我們團隊目前專注的方向,正在為自己的團隊及客戶企業搭建這樣的智能協作系統,讓技術真正落地,讓工作回歸價值、讓企業提升競爭力。

職場與企業不必糾結 AI 有多強,把它當作有潛力但不懂規矩的超級實習生便是。教流程、給標準、驗成果。人機協作能否變成閉環,才是亂局裡的分水嶺。

建議下載收藏

建議下載收藏

參考資料:

Citrini Research. (2026). The 2028 global intelligence crisis [Report]. https://www.citriniresearch.com/p/2028gic

ForkLog. (2026). Anthropic CEO foresees imminent arrival of AGI and job reductions [News article]. https://forklog.com/en/anthropic-ceo-foresees-imminent-arrival-of-agi-and-job-reductions/

METR. (2025). Measuring the impact of early-2025 AI on experienced open-source developer productivity [Blog post]. https://metr.org/blog/2025-07-10-early-2025-ai-experienced-os-dev-study/

YouTube. (2025). Dario Amodei: Anthropic CEO on Claude, AGI & the Future of AI & Humanity [Podcast]. https://youtu.be/ugvHCXCOmm4?si=qdtdV8yHDWkonudB

@張Sir的AI養生館 – 學習智人